首页 > 代码库 > 【Spark亚太研究院系列丛书】Spark实战高手之路-第一章 构建Spark集群(第五步)(2)

【Spark亚太研究院系列丛书】Spark实战高手之路-第一章 构建Spark集群(第五步)(2)

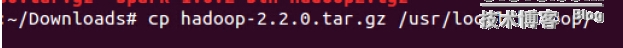

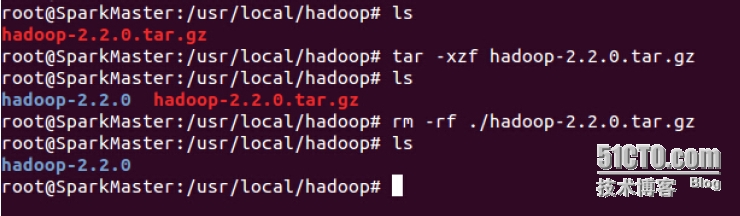

把下载下来的“hadoop-2.2.0.tar.gz”拷贝到“/usr/local/hadoop/”目录下并解压:

修改系统配置文件,修改~/.bashrc文件配置“HADOOP_HOME”并把“HADOOP_HOME”下的bin文件夹加入PATH中,修改完后使用source命令使配置生效。

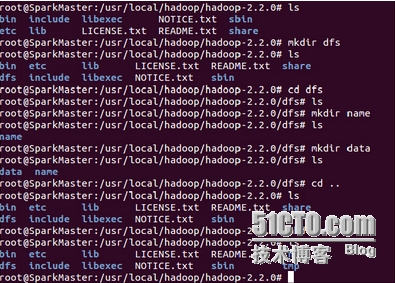

接下来在hadoop目录下按照如下命令创建文件夹:

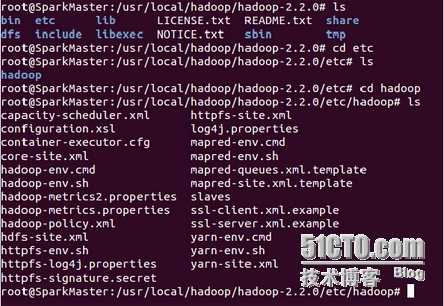

接下来开始修改hadoop的配置文件,首先进入Hadoop 2.2.0配置文件区:

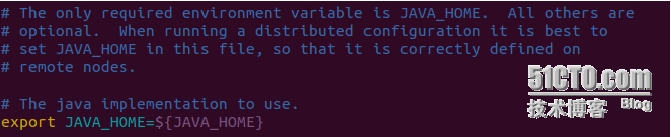

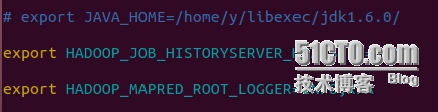

第一步修改配置文件hadoop-env.sh,在其中加入“JAVA_HOME”,如下所示:

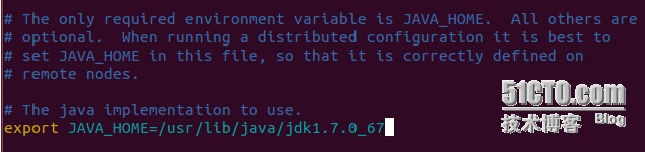

指定我们安装的“JAVA_HOME”:

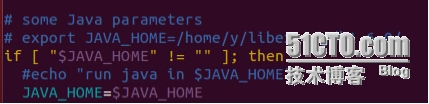

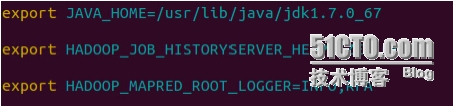

第二步修改配置文件yarn-env.sh,在其中加入“JAVA_HOME”,如下所示:

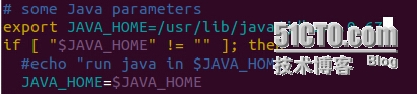

指定我们安装的“JAVA_HOME”:

第三步修改配置文件mapred-env.sh,在其中加入“JAVA_HOME”,如下所示:

指定我们安装的“JAVA_HOME”:

本文出自 “Spark亚太研究院” 博客,请务必保留此出处http://rockyspark.blog.51cto.com/2229525/1561840

【Spark亚太研究院系列丛书】Spark实战高手之路-第一章 构建Spark集群(第五步)(2)

声明:以上内容来自用户投稿及互联网公开渠道收集整理发布,本网站不拥有所有权,未作人工编辑处理,也不承担相关法律责任,若内容有误或涉及侵权可进行投诉: 投诉/举报 工作人员会在5个工作日内联系你,一经查实,本站将立刻删除涉嫌侵权内容。