首页 > 代码库 > Hadoop核心组件:四步通晓HDFS

Hadoop核心组件:四步通晓HDFS

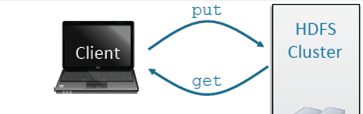

Hadoop分布式文件系统(HDFS)被设计成适合运行在通用硬件上的分布式文件系统,它提供高吞吐量来访问应用程序的数据,适合那些有着超大数据集的应用程序,那么在实际应用中我们如何来操作使用呢?

一、HDFS操作方式:

1、 命令行操作

–FsShell:

$ hdfs dfs

2、 其他的计算框架-如spark

通过URI,比如: hdfs://nnhost:port/file…,调用HDFS的协议、主机、端口或者对外提供的服务媒、以及文件,在spark的程序中实现对HDFS的访问。

3、 其他程序:

(1)Java的API,借助于其他的一些计算框架或者分析工具都可以访问HDFS,如Sqoop加载数据到HDFS,Flume加载日志到HDFS,Impala基于HDFS进行查询

(2)REST API:通过HTP的方式访问HDFS。

二、重点关注HDFS命令行的方式:

(1)从本地磁盘拷贝文件foo.txt到HDFS的用户目录

– 文件将会拷贝到/user/username/foo.txt

(2)获取用户home目录的目录列表

(3)获取HDFS的根目录

(4)显示HDFS文件/user/fred/bar.txt内容

(5)拷贝文件到本地磁盘,命名为baz.txt

(6)在用户home目录下创建input目录

(7)删除input_old目录和所有里面的内容

三、通过HUe进行操作。

通过File Browser可以浏览和管理HDFS的目录和文件,也可以创建、移动、重命名、修改、上传、下载和删除目录和文件,以及查看文件内容

四、HDFS推荐

HDFS是所有数据的仓库,在使用HDFS的时候应该对其目录(如日志目录、数据目录)进行合理地规划和组织。最佳实践方式是定义标准目录结构以及把阶段临时的数据分开。规划示例如下:

(1)/user-用户目录,存放属于个别用户的数据和配置信息

(2)/etl-ETL阶段的数据

(3)/tmp-临时生成的用户在用户间共享的数据

(4)/data-整个组织用来分析的和处理的数据集

(5)/app-非数据文件,比如:配置文件,JAR文件,SQL文件等

掌握以上四步对于应用HDFS有着重要的作用和意义,但是大家应该根据自己的情况循序渐进,注重实践,才可以不断取得进步。我平时喜欢找一些案例进行分析,从而锻炼提升自己的技能,这个比较喜欢“大数据cn ”这个微信服务平台。但是真知更多源于实践,只有学习和了解他人的经验,才可以走的更高更远,我爱关注微信订阅号“大数据时代学习中心”,研究各位数据大牛的经验分享,对于促进我个人的技术成长有着非凡的意义。

Hadoop核心组件:四步通晓HDFS